Ihr KI-Anbieter versprach Transformation. Ihre Data Scientists sind talentiert. Ihr Anwendungsfall ist solide. Dennoch sind die Ergebnisse sechs Monate nach Projektstart enttäuschend. Das Modell funktioniert im Labor, scheitert aber in der Produktion. Vorhersagen sind unzuverlässig. Das Business verliert Vertrauen.

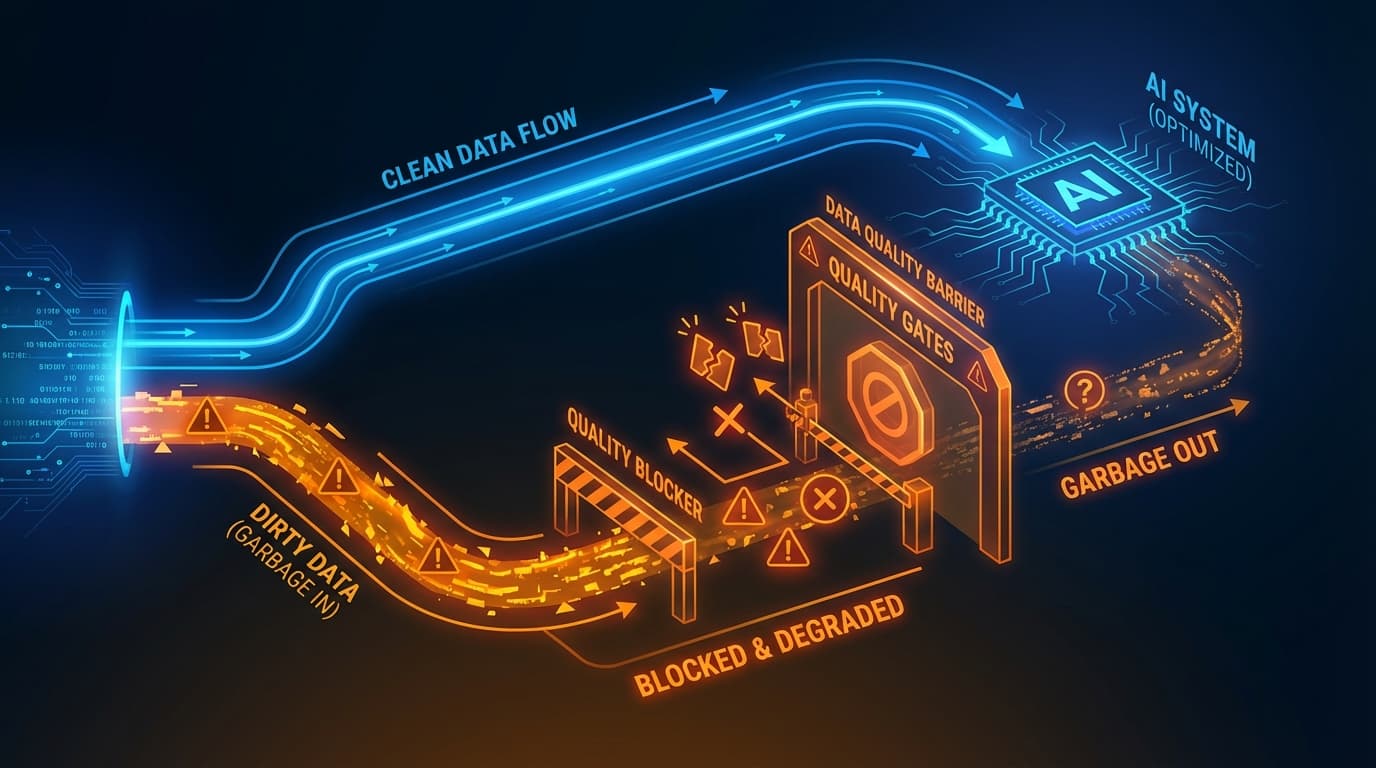

Der Übeltäter ist fast immer derselbe: Datenqualität. Nicht Algorithmen, nicht Rechenleistung, nicht Talent—Daten. Dieser Artikel erklärt, warum Datenqualität KI-Projekte entgleisen lässt und bietet einen praktischen Rahmen zur Behebung.

Warum KI besonders empfindlich auf Datenqualität reagiert

Traditionelle Software toleriert unvollkommene Daten. Ein fehlendes Feld verursacht einen Fehler, aber der Fehler ist sichtbar und oft behandelbar. KI ist anders—und schlimmer.

- Müll rein, selbstbewusst falsch raus: KI-Modelle werfen keine Fehler bei schlechten Daten. Sie produzieren selbstbewusste Vorhersagen, die zufällig falsch sind. Das ist weitaus gefährlicher als ein offensichtlicher Fehler.

- Trainingsdaten definieren Verhalten: Wenn Ihre historischen Daten Verzerrungen, Fehler oder Lücken enthalten, lernt Ihr Modell diese Muster als Wahrheit.

- Edge Cases explodieren: Traditionelle Software behandelt Edge Cases explizit. ML-Modelle interpolieren—oft falsch—wenn sie auf Datenmuster treffen, die im Training nicht repräsentiert sind.

- Drift ist still: Wenn sich Datenmuster im Laufe der Zeit ändern, degradiert die Modellleistung allmählich. Ohne Monitoring bemerken Sie es nicht, bis der Schaden angerichtet ist.

Ein Machine-Learning-Modell, das auf schlechten Daten trainiert wurde, ist eine automatisierte Maschine für schlechte Entscheidungen. Es skaliert Ihre Fehler, nicht Ihre Intelligenz.

Die fünf Datenqualitätsdimensionen für KI

Nicht alle Datenqualitätsprobleme beeinflussen KI gleich. Konzentrieren Sie sich auf diese fünf Dimensionen:

1. Vollständigkeit

Fehlende Werte sind in Unternehmensdaten üblich. Für KI ist die Frage: Warum fehlen sie?

- Zufällig fehlend: Normalerweise mit Imputationstechniken behandelbar

- Nicht zufällig fehlend: Gefährlich—das Fehlen selbst trägt Information, die Imputation zerstört

Beispiel: Kundeneinkommen fehlt oft, wenn Kunden es nicht offenlegen wollen—diese Kunden verhalten sich möglicherweise anders als die, die es offenlegen. Einfache Imputation verbirgt dieses Signal.

2. Konsistenz

Dieselbe Entität sollte über alle Daten hinweg gleich repräsentiert werden. Inkonsistenzen verwirren Modelle:

- Derselbe Kunde mit unterschiedlichen IDs über Systeme hinweg

- Produktkategorien, die zwischen Vertrieb und Lager nicht übereinstimmen

- Datumsformate, die zwischen Quellen variieren

Entity Resolution und Master Data Management sind Voraussetzungen für zuverlässige KI.

3. Genauigkeit

Spiegeln die Daten die Realität wider? Manuelle Eingabefehler, veraltete Informationen und Integrationsfehler erzeugen ungenaue Daten. Für KI:

- Label-Genauigkeit ist kritisch—wenn Ihre Training-Labels falsch sind, lernt Ihr Modell falsche Muster

- Sensordatengenauigkeit beeinflusst IoT- und Predictive-Maintenance-Anwendungsfälle

- Transaktionsgenauigkeit beeinflusst Finanz- und Betrugserkennungsmodelle

4. Aktualität

Veraltete Daten produzieren veraltete Vorhersagen. Bedenken Sie:

- Wie alt sind die Trainingsdaten? Spiegeln sie aktuelle Muster wider?

- Wie oft werden Daten für Inferenz aktualisiert?

- Machen Sie Echtzeit-Vorhersagen mit Batch-Daten?

5. Repräsentativität

Trainingsdaten müssen die Population repräsentieren, für die Sie vorhersagen. Häufige Fehler:

- Training auf erfolgreichen Fällen, wenn Sie Ausfälle vorhersagen müssen

- Training auf Daten einer Region für globalen Einsatz

- Training auf historischen Daten, die jüngste Marktveränderungen nicht enthalten

Die Datenqualitäts-Checkliste für KI-Projekte

Bevor Sie ein Modell trainieren, beantworten Sie diese Fragen:

Daten-Profiling

- Welcher Prozentsatz jedes Features fehlt?

- Was sind die Werteverteilungen? Unerwartete Muster?

- Gibt es offensichtliche Ausreißer oder unmögliche Werte?

- Wie viele doppelte Datensätze existieren?

Datenherkunft

- Wo stammt jedes Datenfeld her?

- Welche Transformationen wurden angewendet?

- Wer ist für Datenqualität bei jedem Schritt verantwortlich?

Label-Qualität

- Wie wurden Labels generiert? Manuelle Annotation? Geschäftsregeln?

- Was ist die Inter-Annotator-Übereinstimmung für manuelle Labels?

- Sind Labels über die Zeit konsistent?

Temporale Überlegungen

- Wie hat sich die Datenverteilung im Laufe der Zeit verändert?

- Gibt es saisonale Muster, die die Repräsentativität beeinflussen?

- Gibt es Target Leakage—Nutzung von Informationen, die zur Vorhersagezeit nicht verfügbar wären?

Datenqualität für KI beheben: Ein praktischer Ansatz

Phase 1: Aktuellen Zustand messen

Sie können nicht verbessern, was Sie nicht messen. Implementieren Sie automatisiertes Datenqualitäts-Monitoring:

- Vollständigkeits-Scores für jedes Feature

- Verteilungsmonitoring zur Drift-Erkennung

- Systemübergreifende Konsistenzprüfungen

- Label-Qualitäts-Sampling und -Review

Phase 2: Kritische Probleme beheben

Nicht alle Datenqualitätsprobleme sind gleich. Priorisieren Sie:

- Probleme, die wichtige Modell-Features betreffen

- Label-Qualitätsprobleme (diese haben die höchste Auswirkung)

- Konsistenzprobleme zwischen Training- und Inferenzdaten

Phase 3: Qualität in die Pipeline einbauen

Datenqualität ist keine einmalige Korrektur. Bauen Sie Prüfungen in Ihre Datenpipeline ein:

- Validierungsregeln an Ingestionspunkten

- Automatisierte Alarme bei Qualitätsverschlechterung

- Regelmäßige Retraining-Trigger, wenn sich Datenmuster verschieben

- Human-in-the-Loop-Review für kritische Vorhersagen

Der Business Case für Datenqualität

Datenqualitätsinvestitionen sind schwer zu rechtfertigen, weil die Kosten schlechter Daten unsichtbar sind—bis KI sie offenlegt. Jedes gescheiterte KI-Projekt, jede unzuverlässige Vorhersage, jede verlorene Geschäftsmöglichkeit führt auf Datenqualität zurück.

Die Organisationen, die mit KI erfolgreich sind, behandeln Datenqualität als Voraussetzung, nicht als Nachgedanken. Sie investieren in Data Engineering, bevor sie in Data Science investieren.

Schwierigkeiten, KI-Projekte zum Laufen zu bringen? Unser Team hilft DACH-Unternehmen, Datenqualität für KI-Bereitschaft zu bewerten und zu verbessern. Wir können Ihnen helfen, Ihren aktuellen Datenqualitätszustand zu verstehen und eine praktische Verbesserungs-Roadmap aufzubauen.